本地部署DeepSeek-R1大模型助力音乐创作

简介

DeepSeek,全称杭州深度求索人工智能基础技术研究有限公司,成立于2023年7月17日,是一家创新型科技公司,专注于开发先进的大语言模型(LLM)和相关技术。

它是一款基于人工智能技术的工具,主要用于信息检索、数据分析和智能推荐。它通过深度学习和大数据分析,帮助用户快速获取和处理信息。简单来说,DeepSeek 就像一个智能助手,能帮你从海量数据中找到你需要的内容,并根据你的需求提供建议。

音乐相关人员能用 DeepSeek 做什么?

学习辅助:查找学习资料,解答问题。

作词作曲:可以帮助我们创作歌词,对词进行作曲。

知识库搭建:搭建专属音乐人自己的知识库。

功能待发掘。。

安装 Ollama

Ollama 是一个轻量级 AI 大模型的运行框架,支持了多个开源模型,我们将使用 Ollama 来运行 DeepSeek 。

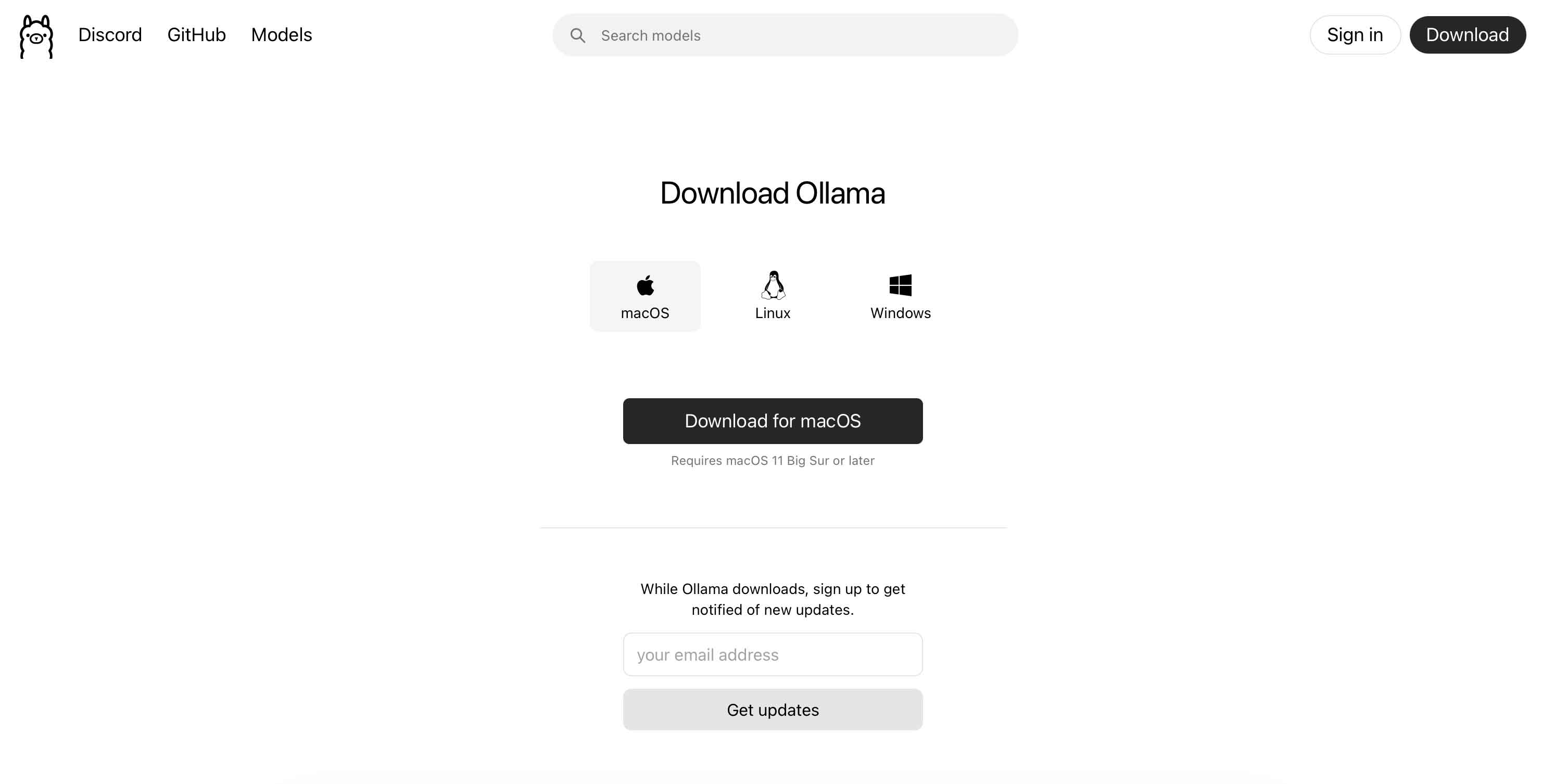

我们首先安装 Ollama ,选择适合自己的电脑系统进行安装。

安装完成后,Win 电脑按下 Win+R键 ,唤出命令提示符窗口,输入 cmd 后回车,等待弹窗出现。Mac 电脑打开启动台然后找到终端打开。输入 ollama - h ,敲击回车键,检查一下 Ollama 是否安装成功。

如果提示你找不到该命令,可以检查一下你系统的环境变量有没有配置 Ollama 的安装目录,如果没有就配置一下。如果有,那重启一下电脑试一试。

安装 DeepSeek

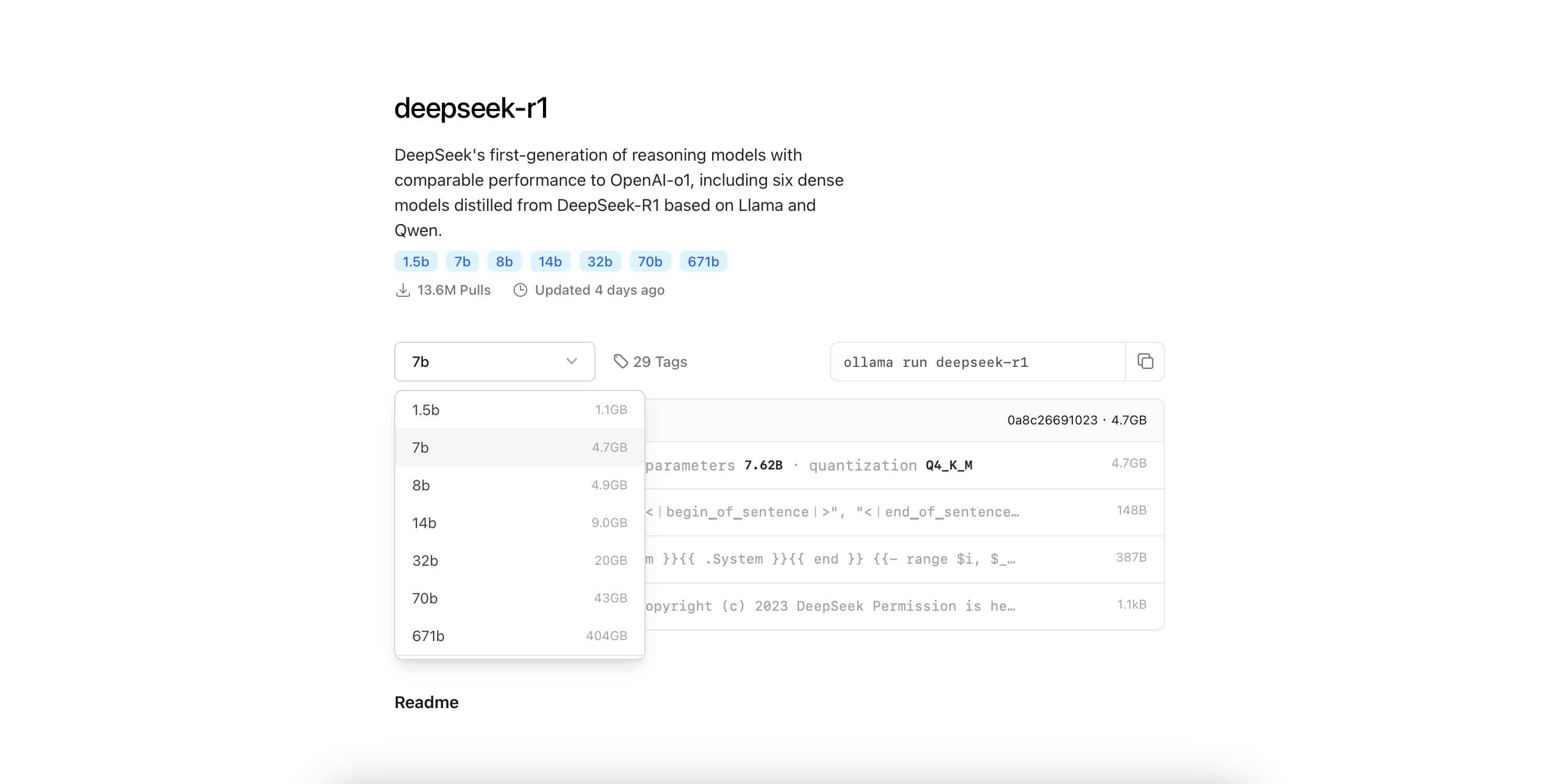

接下来,再次进入 Ollama 官网 ,点击 models 页面,找到「deepseek-r1」模型。或者点击上方链接直接进入,然后选择多少B的模型,主要看自己电脑的配置,Mac 用户主要需要看内存,Windows 用户看显卡显存。

8G内存:1.5B (1.1GB模型大小)

16G内存:8B及以下(4.9GB模型大小)

32G内存:14B及以下(9GB模型大小)

64G内存及以上:32B及以下(20GB模型大小)

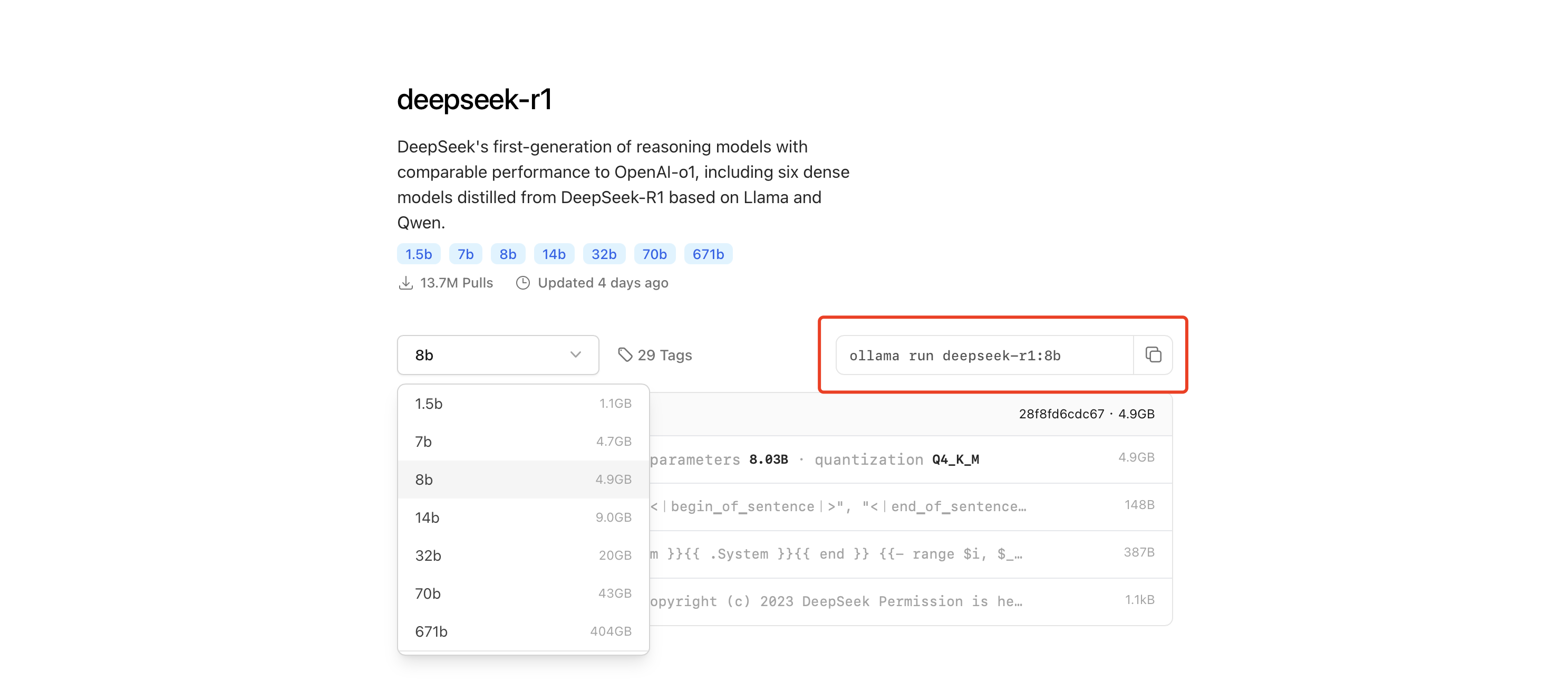

我们在选定之后,务必将后面出现的这一串字符 ollama run deepseek-r1:xxb 进行复制,需要特别提醒的是,不同版本对应的字符各不相同,千万要注意不要复制错了,因为它可是后续部署的关键要点。

安装 UI 交互界面

进入谷歌浏览器 Chrome 插件商店或者 Edge 浏览器扩展商店搜索 Page Assist 插件进行安装,安装完成后配置一下即可使用。